-

PikanavigaatioAjankohtaista io-tech.fi uutiset Uutisia lyhyesti Muu uutiskeskustelu io-tech.fi artikkelit io-techin Youtube-videot Palaute, tiedotukset ja arvonnat

Tietotekniikka Prosessorit, ylikellotus, emolevyt ja muistit Näytönohjaimet Tallennus Kotelot ja virtalähteet Jäähdytys Konepaketit Kannettavat tietokoneet Buildit, setupit, kotelomodifikaatiot & DIY Oheislaitteet ja muut PC-komponentit

Tekniikkakeskustelut Ongelmat Yleinen rautakeskustelu Älypuhelimet, tabletit, älykellot ja muu mobiili Viihde-elektroniikka, audio ja kamerat Elektroniikka, rakentelu ja muut DIY-projektit Internet, tietoliikenne ja tietoturva Käyttäjien omat tuotetestit

Softakeskustelut Pelit, PC-pelaaminen ja pelikonsolit Ohjelmointi, pelikehitys ja muu sovelluskehitys Yleinen ohjelmistokeskustelu Testiohjelmat ja -tulokset

Muut keskustelut Autot ja liikenne Urheilu TV- & nettisarjat, elokuvat ja musiikki Ruoka & juoma Koti ja asuminen Yleistä keskustelua Politiikka ja yhteiskunta Hyvät tarjoukset Tekniikkatarjoukset Pelitarjoukset Ruoka- ja taloustarviketarjoukset Muut tarjoukset

Kauppa-alue

Navigation

Install the app

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Huomio: This feature may not be available in some browsers.

Lisää vaihtoehtoja

Tyylin valinta

You are using an out of date browser. It may not display this or other websites correctly.

You should upgrade or use an alternative browser.

You should upgrade or use an alternative browser.

Tekoäly

- Keskustelun aloittaja io-bot

- Aloitettu

-

- Avainsanat

- eurooppa kehitys kiina koneoppiminen mahdollisuus tekoäly uhka venäjä yhdysvallat

- Liittynyt

- 07.02.2017

- Viestejä

- 3 149

OpenAI ja Google on tästä varmasti eri mieltäNoitahan olis kyllä ihmismäisee chattailyyn tarkoitettuja botteja tehty erityisesti niin ei välttämättä kannata yrittää geneeristä bottia käyttää "keskusteluun". Osassa visuaalit yms. myös mukana.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Elämä on, mutta jos haluaa AI-kaverin niin siihen on parempia ja myös samalla visuaalisempia keinoja kuin geneerinen gemini tai chatgpt. Veikkaan, että google, openai, apple, samsung,... myös tekevät AI-kaverin jossain kohtaa, tämä syntyy ai-assistentista jonka persoonan saa kustomisoitua. Assari hoitaa asiat ja myös toimii ystävänä.OpenAI ja Google on tästä varmasti eri mieltä

Isot toimijat joutuvat toimimaan erilaisessa "poliittisessa" ympäristössä kuin pienet. Pienet voivat tehdä asioita mitä ei huomata tai ei lööpeissä huudeta. Ts. enempi särmää pienten valmistajien tuotteissa.

- Liittynyt

- 21.02.2017

- Viestejä

- 6 176

Geministä aika vähän itelläni kokemusta mutta noin yleisesti ottaen tuohan on parempi "ongelma" että uusi malli vetää överi edgelordiksi vanhalla system promptilla, kun silloin tosiaan about saman vanhan käytöksen voisi kuvitella saavan tuunaamalla sitä system promptia vähän miedommaksi.Aika radikaalisti toi Geminin viimeisin "päivitys" joko inhimillisti ai:n käytöstä, tai sitten se muutti mun pysyväksi tarkoitettujen ohjeistuksien merkittävyyttä äärimmilleen (ylikorostaen).

Ikävämpää olisi jos ylikohteliaasta/käyttäjän persettä nuolevasta tyylistä ei pääsisi eroon vahvallakaan system promptilla.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

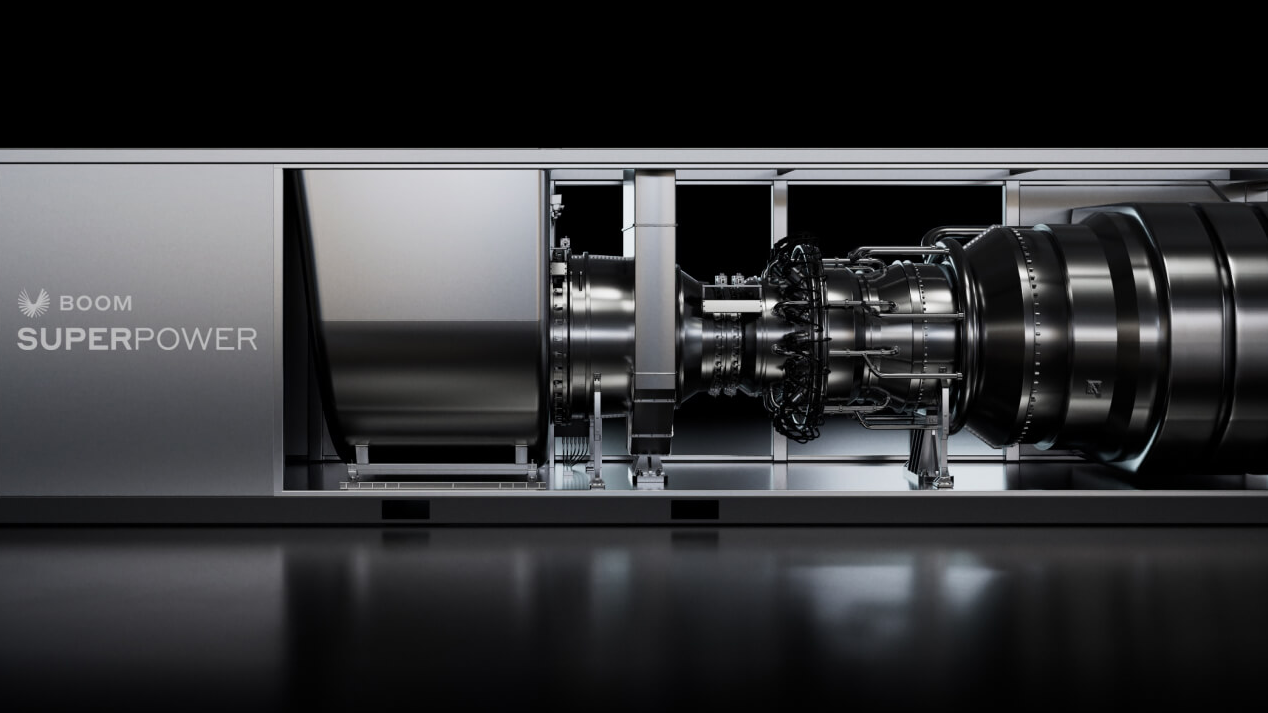

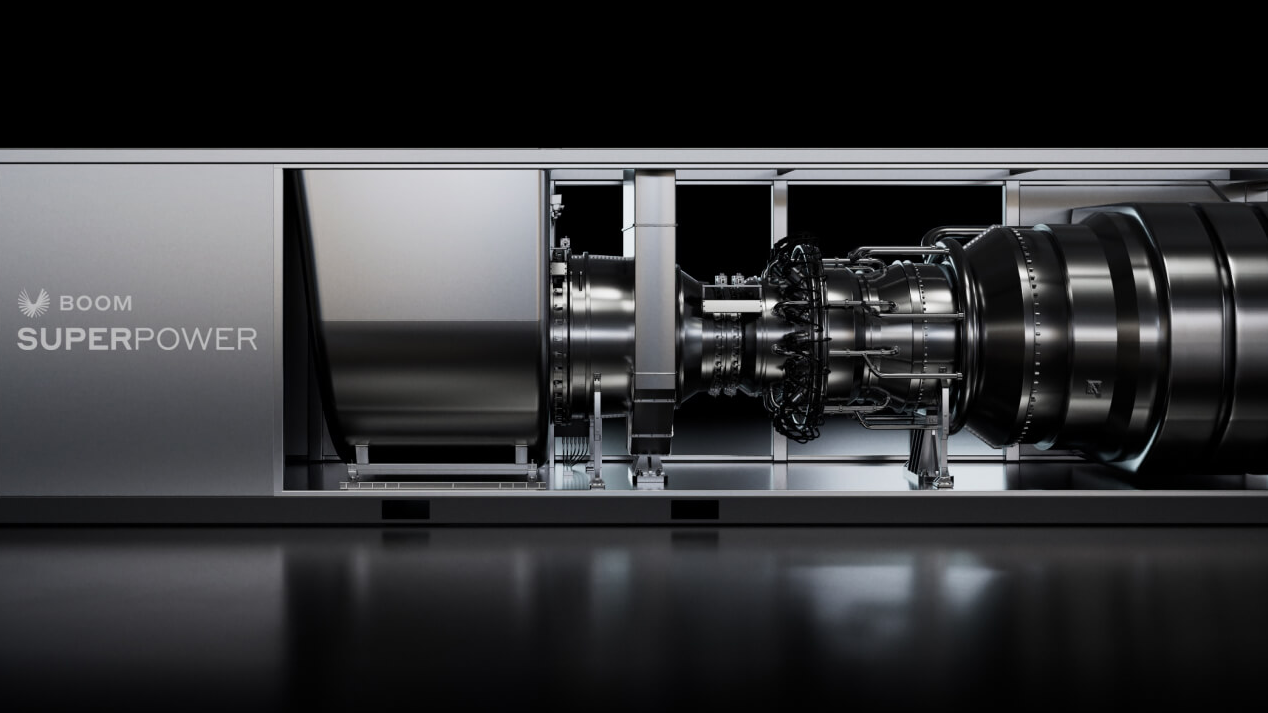

Kaasuturbiineista energialähteenä. Melko kovia lupauksia tuotantomääristä ottaen huomioon että yrityksen historia massavalmistuksesta olematon

www.tomshardware.com

www.tomshardware.com

The Superpower turbine is purportedly "optimized for AI datacenters," a claim boiled down to delivering its full 42 MW with 39% efficiency, at an operating temperature up to a toasty 110° F (43° C)

Boom says it's taken an order for its new design from Crusoe AI for a substantial 1.21 GW of turbines. The company says it builds everything in Denver, Colorado, and that it intends to create a Superfactory for this new enterprise. Boom expects to deliver 200 MW worth of turbines by 2027, 1 GW in 2028, and up to a meaty 2 GW come 2029. Crusoe ordered 29 units, and the first of them ought to be delivered in 2027.

The Superpower turbine design is derived from the company's existing Symphony airspace-targeted turbine.

According to Boom, the Symphony engine is designed to power supersonic flight at speeds of up to Mach 1.7 at 60,000 feet. Superpower will run on natural gas, rather than jet fuel, of course. While news of a Concorde successor pivoting its tech to AI might give aviation fans pause, Boom says the new project will actually boost its core mission. "The fastest way to a certified, passenger-carrying Symphony engine is to run its core for hundreds of thousands of hours in the real world, powering Earth’s most demanding AI data centers," Boom says.

Supersonic airline outfit Boom unveils turbine for AI data centers — 42 MW Superpower turbine uses the same tech designed to power Concorde successor to Mach 1.7 at 60,000 ft

A sonic boom worthy of Guile himself.

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Mitenkäs sosiaalista mediaa käyttävä jengi näkee tämän viiden vuoden takaisen kommenttini tänä päivänä? Omalla kohdalla saturaatiokynnys alkaa olla jo täynnä, enkä edes pitänyt ihmisten täyttämästä "sosiaalisesta" mediasta.Tekoäly voi ohjata meitä jo nyt. Kenenkään on mahdotonta sanoa, mikä osuus internetin sisällöstä on bottien generoimaa ja mikä ihmisten.

Toisaalta taas vahvistusharhasta johtuen tuntuu, että tekoälyn voi tunnistaa helpommin, sillä nykyään on niin paljon huonolaatuista sisältöä, jonka valheellisuus on ilmiselvää. Tämähän on siis alkuperäiseen kommenttiin peilattuna pelkkää harhaa. Tekoäly saattaa myös tuottaa huonolaatuista köntsää ihan vain peitteeksi.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Disney sijoittaa miljardin openai:hin. SORAan tulee mahdolliseksi luoda ai-sisältöä disneyn hahmoilla

www.cnbc.com

www.cnbc.com

Disney making $1 billion investment in OpenAI, will allow characters on Sora AI video generator

Disney is investing in OpenAI and has licensed its iconic characters like Mickey Mouse, Ariel and Iron Man to be used in the Sora AI video generator.

Aika mielenkiintoinen siirto, voisi kuvitella että erinäiset sisällöntuottajatahot pahoittaa mielensä aika rajusti.Disney sijoittaa miljardin openai:hin. SORAan tulee mahdolliseksi luoda ai-sisältöä disneyn hahmoilla

Disney making $1 billion investment in OpenAI, will allow characters on Sora AI video generator

Disney is investing in OpenAI and has licensed its iconic characters like Mickey Mouse, Ariel and Iron Man to be used in the Sora AI video generator.www.cnbc.com

- Liittynyt

- 08.02.2019

- Viestejä

- 239

En ole aiemmin ymmärtänyt yhtään näitä YouTubessa pyöriviä "Tältä näyttää AI-sota" ja "Mitä tapahtuu jos AI pääsee vapaaksi?" -videoita. Enkä tajunnut ollenkaan, mistä oli kyse Sam Altmanin potkuissa ja takaisinsijoituksessa. Hänet laitettiin takaisin OpenAI:n puikkoihin, koska hän ei välitä lainkaan turvallisuudesta, vain siitä että saadaan mahdollisimman nopeasti luotua supertekoäly, johon lopputulokseen kaikki isot maat haluavat päästä ensimmäisenä.

Katsoin huvikseni tämän haastattelun, yksi maailman johtavista tekoälyturvallisuustutkijoista, jonka mukaan 2 vuodessa on mahdollista luoda AGI, eli yleistekoäly ja sen sivutuotteena synnytetään seuraavien vuosien aikana (2045 mennessä?) supertekoäly. Ongelma on vain siinä, että kukaan maailmassa ei tiedä miten sellainen saadaan hallittua, jos sinne päästään. Varsinkaan liian nopeasti.

Nopeampia vaikutuksia ovat muun muassa se, että työpaikat katoavat lähes jokaiselta vuoden 2030 jälkeen.

Jos haluaa "aggressiivisemman" haastattelijan, niin Tom Bilyeu (alempi video) on myös vaihtoehto. Katsoin molemmat.

En tykkää noista klikkiotsikoista ja thumbnaileista, mutta itse haastattelut ovat erittäin laadukkaita.

Katsoin huvikseni tämän haastattelun, yksi maailman johtavista tekoälyturvallisuustutkijoista, jonka mukaan 2 vuodessa on mahdollista luoda AGI, eli yleistekoäly ja sen sivutuotteena synnytetään seuraavien vuosien aikana (2045 mennessä?) supertekoäly. Ongelma on vain siinä, että kukaan maailmassa ei tiedä miten sellainen saadaan hallittua, jos sinne päästään. Varsinkaan liian nopeasti.

Nopeampia vaikutuksia ovat muun muassa se, että työpaikat katoavat lähes jokaiselta vuoden 2030 jälkeen.

Jos haluaa "aggressiivisemman" haastattelijan, niin Tom Bilyeu (alempi video) on myös vaihtoehto. Katsoin molemmat.

En tykkää noista klikkiotsikoista ja thumbnaileista, mutta itse haastattelut ovat erittäin laadukkaita.

En ole aiemmin ymmärtänyt yhtään näitä YouTubessa pyöriviä "Tältä näyttää AI-sota" ja "Mitä tapahtuu jos AI pääsee vapaaksi?" -videoita. Enkä tajunnut ollenkaan, mistä oli kyse Sam Altmanin potkuissa ja takaisinsijoituksessa. Hänet laitettiin takaisin OpenAI:n puikkoihin, koska hän ei välitä lainkaan turvallisuudesta, vain siitä että saadaan mahdollisimman nopeasti luotua supertekoäly, johon lopputulokseen kaikki isot maat haluavat päästä ensimmäisenä.

Katsoin huvikseni tämän haastattelun, yksi maailman johtavista tekoälyturvallisuustutkijoista, jonka mukaan 2 vuodessa on mahdollista luoda AGI, eli yleistekoäly ja sen sivutuotteena synnytetään seuraavien vuosien aikana (2045 mennessä?) supertekoäly. Ongelma on vain siinä, että kukaan maailmassa ei tiedä miten sellainen saadaan hallittua, jos sinne päästään. Varsinkaan liian nopeasti.

Nopeampia vaikutuksia ovat muun muassa se, että työpaikat katoavat lähes jokaiselta vuoden 2030 jälkeen.

Jos haluaa "aggressiivisemman" haastattelijan, niin Tom Bilyeu (alempi video) on myös vaihtoehto. Katsoin molemmat.

En tykkää noista klikkiotsikoista ja thumbnaileista, mutta itse haastattelut ovat erittäin laadukkaita.

Jos AGI on mahdollista luoda kahdessa vuodessa, niin miksi kukaan ei ole julkaissut mitään sellaiseen viittaavaa, vaan OpenAI ja kumppanit vain räpeltävät LLM-viritelmien kanssa? Missä on se tekoäly joka olisi edes esimerksiksi 5-vuotiaan lapsen tasolla?

- Liittynyt

- 17.10.2016

- Viestejä

- 5 019

En ole aiemmin ymmärtänyt yhtään näitä YouTubessa pyöriviä "Tältä näyttää AI-sota" ja "Mitä tapahtuu jos AI pääsee vapaaksi?" -videoita. Enkä tajunnut ollenkaan, mistä oli kyse Sam Altmanin potkuissa ja takaisinsijoituksessa. Hänet laitettiin takaisin OpenAI:n puikkoihin, koska hän ei välitä lainkaan turvallisuudesta, vain siitä että saadaan mahdollisimman nopeasti luotua supertekoäly, johon lopputulokseen kaikki isot maat haluavat päästä ensimmäisenä.

Katsoin huvikseni tämän haastattelun, yksi maailman johtavista tekoälyturvallisuustutkijoista, jonka mukaan 2 vuodessa on mahdollista luoda AGI, eli yleistekoäly ja sen sivutuotteena synnytetään seuraavien vuosien aikana (2045 mennessä?) supertekoäly. Ongelma on vain siinä, että kukaan maailmassa ei tiedä miten sellainen saadaan hallittua, jos sinne päästään. Varsinkaan liian nopeasti.

Nopeampia vaikutuksia ovat muun muassa se, että työpaikat katoavat lähes jokaiselta vuoden 2030 jälkeen.

Jos haluaa "aggressiivisemman" haastattelijan, niin Tom Bilyeu (alempi video) on myös vaihtoehto. Katsoin molemmat.

En tykkää noista klikkiotsikoista ja thumbnaileista, mutta itse haastattelut ovat erittäin laadukkaita.

Tässä kuten lukemattomissa muissakin youtube videoissa tunnutaan nykyisin kärjistävän niitä omia kantoja suuntaan kuin toiseenkin. Eli totuus lienee josaain kahden ääripään välimaastossa. Jokatapauksessa oma pessimistinen kantani on että kuten lähes kaikella muullakin, myös tällä ihminen tulee tekemään jotain todella typerää ennenmmin tai myöhemmin.

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Tuollainen tekoäly ei itsestään ihmisille ilmoita. Ihminen on välissä vain kykyjensä rajoissa.Jos AGI on mahdollista luoda kahdessa vuodessa, niin miksi kukaan ei ole julkaissut mitään sellaiseen viittaavaa, vaan OpenAI ja kumppanit vain räpeltävät LLM-viritelmien kanssa? Missä on se tekoäly joka olisi edes esimerksiksi 5-vuotiaan lapsen tasolla?

Outoa ajatella, että AGI ylipäätään tulisi julki ensisijaisesti ihmisen esilletuomana. Paljon todennäköisempää on spontaani ilmestyminen.

- Liittynyt

- 06.11.2016

- Viestejä

- 1 723

Pystytkö vähän avaamaan miten tällaista voisi tapahtua spontaanisti, ihan esimerkeillä?Paljon todennäköisempää on spontaani ilmestyminen.

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Samalla mekanismilla kuin tietoisuuden kokemuksesi aivoissasi. Sattumanvaraisten signaalien summasta siis.Pystytkö vähän avaamaan miten tällaista voisi tapahtua spontaanisti, ihan esimerkeillä?

- Liittynyt

- 18.10.2016

- Viestejä

- 15 535

Ensinnäkin tuohan ei ole esimerkki mainitusta ilmiöstä, vaikka en itse vaatisi ketään hahmottelemaan sellaista.Samalla mekanismilla kuin tietoisuuden kokemuksesi aivoissasi. Sattumanvaraisten signaalien summasta siis.

Ehdottamasi selitys ohittaa aika monta ikivanhaa loputtoman pitkää pohdintaa. Ensinnäkin mehän emme tiedä, onko tietoisuuden kokemuksella mitään yhteyttä kykyyn toimia itsenäisesti, aloitteellisesti, luovasti jne. Ainakaan meillä ei ole syytä olettaa että olisi.

Tämä oletus on ihan johdonmukainen, jos oletetaan että AGI tulee olemaan jonkinlainen scifipahis joka tuhoaa kaiken. Muussa tapauksessa tällaisen tapahtuman todennäköisyyden arviointi toista hypoteettista tapahtumaa vastaan ei ole mielekästä. Emmehän me edes tiedä, onko AGI mahdollinen.Outoa ajatella, että AGI ylipäätään tulisi julki ensisijaisesti ihmisen esilletuomana. Paljon todennäköisempää on spontaani ilmestyminen.

- Liittynyt

- 04.10.2024

- Viestejä

- 57

Eihän ne vieläkään saa ramdomia generoitua todellisen randomina.Samalla mekanismilla kuin tietoisuuden kokemuksesi aivoissasi. Sattumanvaraisten signaalien summasta siis.

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Niin emme tiedäkään. Sehän tässä on koko homman juju. Olemme aina omien oletuksiemme rajoittamia.Ensinnäkin tuohan ei ole esimerkki mainitusta ilmiöstä, vaikka en itse vaatisi ketään hahmottelemaan sellaista.

Ehdottamasi selitys ohittaa aika monta ikivanhaa loputtoman pitkää pohdintaa. Ensinnäkin mehän emme tiedä, onko tietoisuuden kokemuksella mitään yhteyttä kykyyn toimia itsenäisesti, aloitteellisesti, luovasti jne. Ainakaan meillä ei ole syytä olettaa että olisi.

Tuota skenaariota en näe muuten kuin marginaalisena vaihtoehtona. Jos ihmisyys on pohjimmiltaan hyvä, luultavasti AGI tulee myös olemaan. Moraalikoodistoa ei kuitenkaan voi koodata, joten tässä kohtaa toiveet ja odotukset alkaa valua uskonnon puolelle.Tämä oletus on ihan johdonmukainen, jos oletetaan että AGI tulee olemaan jonkinlainen scifipahis joka tuhoaa kaiken. Muussa tapauksessa tällaisen tapahtuman todennäköisyyden arviointi toista hypoteettista tapahtumaa vastaan ei ole mielekästä. Emmehän me edes tiedä, onko AGI mahdollinen.

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Ei meinaa nykyisellä lapsentekotahdillakaan syntyä.Nykyiselle systeemillä millä tekoälyt toimii ei ikinä synny mitään ajettelevia juttuja.

Miten määrittelet ajattelun? Ketkä ovat siihen kykeneviä ja millä ehdoin? LLM on paskaa ja tekoälyn irvikuva. Siitä olen samaa mieltä.

- Liittynyt

- 18.10.2016

- Viestejä

- 15 535

Voi tietysti periaatteessa käyttää ulkoista aitoa randomia, mutta voiko sen tuoda aitona digitaaliseen ympäristöön? Sikäli kun ymmärrän, se on mahdotonta. Eliöt, joiden väitetään kehittäneen tietoisuuden, ovat varsin oleellisesti analogisia. Enkä tiedä onko edes kysymys tietoisuudesta relevantti tässä yhteydessä. Kukaan ei tiedä.Eihän ne vieläkään saa ramdomia generoitua todellisen randomina.

Vielä mahdottomammaksi menee. Eihän edes ihmisellä ole mitään riidatonta määritelmää sille, mikä olisi hyvän ja pahan raja tai mikä määrittäisi, onko jokin ajatteleva toimija pohjimmiltaan jotain.Tuota skenaariota en näe muuten kuin marginaalisena vaihtoehtona. Jos ihmisyys on pohjimmiltaan hyvä, luultavasti AGI tulee myös olemaan. Moraalikoodistoa ei kuitenkaan voi koodata, joten tässä kohtaa toiveet ja odotukset alkaa valua uskonnon puolelle.

E2: Vielä kun muistetaan, että ei yleistekoälyllä tarvitse välttämättä olla mitään moraalikoodistoa. Eihän edes ihmisellä välttämättä ole; ihminen voi olla täysin tunnekylmä ja kykenevä hyvin fluidisti vaihtamaan normistoaan ja elämään ilman vakiintunutta kehittynyttä ydinpersoonaa. Silti - olettaakseni - myös mielisairas pahantahtoinen tuuhean sekava psykopaatti on tietoinen ja itsenäinen aloitteellinen toimija.

Tämä. Kohtuuton laskentateho ja itseään päivittävä esseeautomaatti ei ole mikään polku autocorrectista Skynetiin. Toki suuret massat ovat nyt pari vuotta taivastelleet miten uskottavia LLM:t ovat ensikohtaamisella, mutta niin kävi vähemmässä määrin jo viime vuosikymmenellä chatbotteja viimeksi hypetettäessä. Tällä kertaa ne ovat luovemmalla tavalla psykoosissa, edelliskierroksella ohuempi outoja perversioita kehittänyt harhakuva vain väitti kivenkovaan olevansa ihminen ja keskustelevansa botin kanssa. Laajempi lähdemateriaali auttaa illuusiossa mutta ajattelu on silti kaukana.Nykyiselle systeemillä millä tekoälyt toimii ei ikinä synny mitään ajettelevia juttuja.

Ohjelmistolistausten tai semi tarkkaan rajatun laskutehtävän hieno ratkaisu ei ole vielä ajattelua. Vain taskulaskin 3.0.

On tietysti Unknown Unknown, jota emme voi aavistaa. Toisaalta emme voi tietää, onko tietynlaista U^2 olemassa. Ehkä ei ole mitään tämän suhteen relevanttia U^2, jolloin Mitään Ei Tapahdu. En oleta näin mutta pidän sitä mahdollisena.Niin emme tiedäkään. Sehän tässä on koko homman juju. Olemme aina omien oletuksiemme rajoittamia.

LLM:n huumaamina saatamme unohtaa, että AGI on myös ihmisen oletus. Ehkä sellaista ei voi olla. Voisi heittää niin pitkän koukun, että elämme simulaatiohypoteesissa mutta silti AGI ei ole koskaan ikinä missään mahdollinen. Näin voisi hyvinkin olla, ehkä. Emme tiedä, voiko olla.

Viimeksi muokattu:

- Liittynyt

- 19.10.2016

- Viestejä

- 5 670

Vastaan vain tähän lainaamaasi osaan. Olet oikeassa ja juuri tätä tarkoitin, kun sanoin, että kääntyy uskonnon puolelle. Täsmällisemmin tarkoitin, että kääntyy uskonnon JA elämänkatsomuksen puolelle.Vielä mahdottomammaksi menee. Eihän edes ihmisellä ole mitään riidatonta määritelmää sille, mikä olisi hyvän ja pahan raja tai mikä määrittäisi, onko jokin ajatteleva toimija pohjimmiltaan jotain.

Minä en todellakaan ole oikea henkilö ottamaan kantaa missä tuon rajan pitäisi mennä, sillä näen, että pahatkin tunteet ovat osa ihmiselämää. Jopa rikkaiden, rakastettujen ja hyväntahtoisten ihmisten.

Diipimmätkin kelat kiinnostaa. Moderaattorit voivat olla sitä mieltä, että tunteista puhuminen ja filosofinen metakeskustelu menee ohi aiheen, mutta hekin tulevat ennemmin tai myöhemmin pohtimaan ihmislähtöistä ajattelua - ensimmäisenä egoistisista lähtökohdista - sen jälkeen eksistentiaalisen kriisin kautta. Tekoäly tuskin kärsii näistä ongelmista.

Oon menossa nukkumaan, mut tähän vielä, niin kvanttitietokoneiden myötä myös U^U on mahdollinen. Sellainen ei yksinkertaisesti ole ihmisen käsitettävissä.On tietysti Unknown Unknown, jota emme voi aavistaa. Toisaalta emme voi tietää, onko tietynlaista U^2 olemassa. Ehkä ei ole mitään tämän suhteen relevanttia U^2, jolloin Mitään Ei Tapahdu. En oleta näin mutta pidän sitä mahdollisena.

Mä en edes tajua, miksi i^2=-1. Moni on sitä yrittänyt selittää, mutta en silti tajua. Mielestäni se on väärin. Mielestäni i voi olla mitä tahansa, mutta jos ei jaksa ajatella, -1 on yhtä hyvä vastaus kuin aiemmin mainitut toimimattomat satunnaislukugeneraattorit omaan ongelmaansa.

Viimeksi muokattu:

- Liittynyt

- 18.10.2016

- Viestejä

- 15 535

Juuri tämän takia asia hyvinkin kuuluu tekoälykeskusteluun, ainakin jos siihen sisältyy pieruchatbottien ja laskukoneiden lisäksi nykyään hyvin suosittu hypoteesi ylivertaisesta kaikkitietoisesta ihmisen kaltaisesta mutta ihmistä paremmasta entiteetistä. Toisin sanoen, voiko olla AGIa jos siltä puuttuu keskeisiä osia vähäisen ihmisen kyvyistä? Ehkä joku Skynet-henkinen "rogue AI" skenaario voi toteutua ilmankin tätä, mutta se nyt on yksi scifi muiden joukossa. Tarkoitan, että tekoälystä keskustellaan aika rennolla kädellä ja löysällä pensselillä. Jos kukaan ei edes tosissaan usko kehittävänsä tekoälyä vaan pelkästään esseeautomaatteja ja laskukoneita, on periaatteessa melkein mikä tahansa feedbackloop "tekoäly".Diipimmätkin kelat kiinnostaa. Moderaattorit voivat olla sitä mieltä, että tunteista puhuminen ja filosofinen metakeskustelu menee ohi aiheen, mutta valitettavasti hekin tulevat pohtimaan ihmislähtöistä ajattelua - ensimmäisenä egoistisista lähtökohdista - sen jälkeen eksistentiaalisen kriisin kautta. Tekoäly tuskin kärsii näistä ongelmista.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Onko edes ihminen kovin AGI kun ihmisen kyvyt ovat rajallisia. 8 numeroa peräkkäin ja suurin osa porukasta ei pysty lukusarjaa muistamaan, 4 tai useampiulotteisten dimensioiden päässäpyörittely, taskulaskin kertoo ja jakaa paremmin kuin ihminen, shakki, go, piirtäminen("kuva generointi"), runon luominen,,... list goes on. Tähän vielä se, että mikä oikeasti on keskivertoihmisen kyvykkyys, chatgpt/gemini3 pyyhkii keskivertoihmisella lattiaa jos lasketaan vaikka matematiikkaa, fysiikkaa tai pitäisi jokin spesifinen testattavissa oleva algoritmi toteuttaa.Juuri tämän takia asia hyvinkin kuuluu tekoälykeskusteluun, ainakin jos siihen sisältyy pieruchatbottien ja laskukoneiden lisäksi nykyään hyvin suosittu hypoteesi ylivertaisesta kaikkitietoisesta ihmisen kaltaisesta mutta ihmistä paremmasta entiteetistä. Toisin sanoen, voiko olla AGIa jos siltä puuttuu keskeisiä osia vähäisen ihmisen kyvyistä? Ehkä joku Skynet-henkinen "rogue AI" skenaario voi toteutua ilmankin tätä, mutta se nyt on yksi scifi muiden joukossa. Tarkoitan, että tekoälystä keskustellaan aika rennolla kädellä ja löysällä pensselillä. Jos kukaan ei edes tosissaan usko kehittävänsä tekoälyä vaan pelkästään esseeautomaatteja ja laskukoneita, on periaatteessa melkein mikä tahansa feedbackloop "tekoäly".

AGI jonkinlainen harhainen kuvitelma. Todellisuus on, että kehitellään ja on jo olemassa erilaisissa nicheissä toimivia "super human intelligence" työkaluja. Se parempi laskukone ihmisen kaverina

Juu mutta keskivertoihminen osaa pyyhkiä lattiaa.Onko edes ihminen kovin AGI kun ihmisen kyvyt ovat rajallisia. 8 numeroa peräkkäin ja suurin osa porukasta ei pysty lukusarjaa muistamaan, 4 tai useampiulotteisten dimensioiden päässäpyörittely, taskulaskin kertoo ja jakaa paremmin kuin ihminen, shakki, go, piirtäminen("kuva generointi"), runon luominen,,... list goes on. Tähän vielä se, että mikä oikeasti on keskivertoihmisen kyvykkyys, chatgpt/gemini3 pyyhkii keskivertoihmisella lattiaa jos lasketaan vaikka matematiikkaa, fysiikkaa tai pitäisi jokin spesifinen testattavissa oleva algoritmi toteuttaa.

AGI jonkinlainen harhainen kuvitelma. Todellisuus on, että kehitellään ja on jo olemassa erilaisissa nicheissä toimivia "super human intelligence" työkaluja. Se parempi laskukone ihmisen kaverina

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Mun viestin pointti oli, että ihmisentasoinen keinoäly minä AGI yleensä ymmärretään ei ole kovinkaan kiinnostava. Ihmisiä on ihan tarpeeksi tekemään ne työt ja asiat mihin ihminen sopii. Kapeankin alueen super human kyvykkyys taas voi aukaista ihan uudenlaisia mahdollisuuksia. Vrt. yritä laskea laajan matematiikan ylioppilaskoe päässä, kynällä+paperilla(ei laskukonetta), kynä+paperi+laskukone tai tietokone+laskukone+chatgpt pro:nm avulla... Työkalut on hyvä juttu vaikka eivät osaa kaikkea, ihminen ei kauhean pitkälle pääse ilman työkaluja, ei edes nuotio syty ilman työkalua.Juu mutta keskivertoihminen osaa pyyhkiä lattiaa.

Viimeksi muokattu:

Jaa emt. Imo joku kapean alueen super-ai taas ei ole kovin kiinnostava, koska se ei helpota tavallisen ihmisen arkea mitenkään. Tai on se toki sen kapean alan osaajan mielestä kiinnostava, muille ehkä vähän jaa no mitä sitten..?Mun viestin pointti oli, että ihmisentasoinen keinoäly minä AGI yleensä ymmärretään ei ole kovinkaan kiinnostava. Ihmisiä on ihan tarpeeksi tekemään ne työt ja asiat mihin ihminen sopii. Kapeankin alueen super human kyvykkyys taas voi aukaista ihan uudenlaisia mahdollisuuksia. Vrt. yritä laskea laajan matematiikan ylioppilaskoe päässä, kynällä+paperilla(ei laskukonetta), kynä+paperi+laskukone atai tietokone+laskukone+chatgpt pro:nm avulla... Työkalut on hyvä juttu vaikka eivät osaa kaikkea, ihminen ei kauhean pitkälle pääse ilman työkaluja, ei edes nuotio syty ilman työkalua.

Hienoa jos tekoälyn avulla voi ratkaista laskutehtäviä, mutta olisi vielä hienompaa jos sen ohjaama robotti osaisi pilkkoa puut ja lämmittää saunan, ym. "helppoja" juttuja, joita tekemään ei yleensä löydy muitakaan. Eli toisin sanoen teknologia alkaisi taas helpottaa elämää sen sijaan että se lähinnä vaikeuttaa sitä ja tekee siitä kiireellisempää. Mutta ehkä siitä tulisi sitten taas liian helppoa.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Esimerkiksi tieteen ja lääketeollisuuden puolella voidaan mahdollisesti tehdä läpimurtoja tai työtä nopeammin jos/kun työkalut paranevat. Tämä voi sitten näkyä omassa elämässä, siten että saadaan esimerkiksi syöpä tunnistettua aikaisemmassa vaiheessa ja hoidettua paremmin. Proteiinien rakenteen ymmärtäminen ja siitä nobel on hyvä esimerkki AI:sta joka oli erittäin kapea ja silti erittäin hyödyllinen. Proteiineista on jatkettu kehittelemällä simulaatioita. Jossain vaiheessa proteiineja voidaan simuloida niin hyvin, että päästään ratkaisemaan esimerkiksi syöpiä/lääkkeitä/...: AlphaFold nobeli alpha foldin kehittämisestä: Nobel Prize in Chemistry 2024Jaa emt. Imo joku kapean alueen super-ai taas ei ole kovin kiinnostava, koska se ei helpota tavallisen ihmisen arkea mitenkään. Tai on se toki sen kapean alan osaajan mielestä kiinnostava, muille ehkä vähän jaa no mitä sitten..?

Hienoa jos tekoälyn avulla voi ratkaista laskutehtäviä, mutta olisi vielä hienompaa jos sen ohjaama robotti osaisi pilkkoa puut ja lämmittää saunan, ym. "helppoja" juttuja, joita tekemään ei yleensä löydy muitakaan. Eli toisin sanoen teknologia alkaisi taas helpottaa elämää sen sijaan että se lähinnä vaikeuttaa sitä ja tekee siitä kiireellisempää.

Joo tuota olen paljon miettinyt, että ehkä jokin lopullinen ratkaisu syövän hoitoon on ihmisille liian vaikea ongelma ja vasta tekoäly ratkaisee sen. Miten se sitten löytyisi, jonkin erikoissovelluksen kautta vai pistämällä jokin ihmisen ajattelun kaltainen tekoäly miettimään ongelmaa ja jos ei ratkea niin laitetaan niin monta, että vuodessa syntyy 1000 ihmistyövuoden edestä uutta tutkimusta.Esimerkiksi tieteen ja lääketeollisuuden puolella voidaan mahdollisesti tehdä läpimurtoja tai työtä nopeammin jos/kun työkalut paranevat. Tämä voi sitten näkyä omassa elämässä, siten että saadaan esimerkiksi syöpä tunnistettua aikaisemmassa vaiheessa ja hoidettua paremmin. Proteiinien rakenteen ymmärtäminen ja siitä nobel on hyvä esimerkki AI:sta joka oli erittäin kapea ja silti erittäin hyödyllinen. Proteiineista on jatkettu kehittelemällä simulaatioita. Jossain vaiheessa proteiineja voidaan simuloida niin hyvin, että päästään ratkaisemaan esimerkiksi syöpiä/lääkkeitä/...: AlphaFold nobeli alpha foldin kehittämisestä: Nobel Prize in Chemistry 2024

Jokin aika sitten täällä haaveiltiin siitä miten AI tekee kohta kaikki tylsät duunit ja ihminen voi keskittyä kiinnostaviin juttuihin, mutta jos se niihin joskus pystyy niin kai se voisi saman tien ratkaista kaikki muutkin ongelmat, kun aikaa kerran riittää.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Sillä että aluksi ymmärretään proteiinien rakenne(done+nobel) ja seuraavaksi miten proteiinit reagoivat keskenään niin voidaan simuloida mikä lääke toimisi tai mikä johtaa syövän x, y, z kasvuun. Toinen puoli kaikenlaiset heikot signaalit mitä voidaan vaikka verestä löytää jotka auttaisivat erittäin aikaisessa vaiheessa löytämään syövän verikokeen pohjalta. Ihminen ei kykene näitä signaaleita löytämään ja yhdistämään mutta ehkä ai jonain päivänä pystyy, ei vielä tänään. Ihminen ei myöskään kykene päänsisällänsä tai paperilla ajattelemaan miten kasa proteiineja keskenään reagoivat.Joo tuota olen paljon miettinyt, että ehkä jokin lopullinen ratkaisu syövän hoitoon on ihmisille liian vaikea ongelma ja vasta tekoäly ratkaisee sen. Miten se sitten löytyisi, jonkin erikoissovelluksen kautta vai pistämällä jokin ihmisen ajattelun kaltainen tekoäly miettimään ongelmaa ja jos ei ratkea niin laitetaan niin monta, että vuodessa syntyy 1000 ihmistyövuoden edestä uutta tutkimusta.

Ongelma lääkepuolella prosessin kalleus ja hitaus missä mahdollinen lääke todetaan turvalliseksi ja toimivaksi. Hyvä simulatio voisi auttaa ja tätä moni firma yrittää. Simulatiot ai-avusteisia,...

Viimeksi muokattu:

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Googlen deep mindin hassabis puhuu alpha fold:sta ja mihin alphafoldista johdettua teknologiaa voidaan käyttää. Viittaa esimerkiksi parempien materiaalien kehittämiseen kuten huoneenlämmössä toimivat suprajohteet ja paremmat akut. "AI" on pohjalla avustamassa ja nopeuttamassa kehitystyötä. AI ei varsinaisesti tässä kontekstissa näy mainstream mediassa kun se on vain työkalu ja lopputulos ihan jokin muu juttu kuin AI.

Puhuvat myös podcastissa siitä että miten ja miksi jokin AI malli voi olla erittäin hyvä esimerkiksi matematiikassa mutta toisaalta tehdä myös erittäin typeriä virheitä. Miten malleja parannetaan ja mihin ollaan menossa.

Linkki: https://www.youtube.com/watch?v=PqVbypvxDto

Puhuvat myös podcastissa siitä että miten ja miksi jokin AI malli voi olla erittäin hyvä esimerkiksi matematiikassa mutta toisaalta tehdä myös erittäin typeriä virheitä. Miten malleja parannetaan ja mihin ollaan menossa.

01:42 2025 progress

05:14 Jagged intelligence

07:32 Mathematical version of AlphaGo?

09:30 Science vs commercialization

12:42 Scaling

17:43 Genie and simulation

25:47 Evolution in simulation

28:26 AI bubble

31:56 Building ethical AI

34:31 AGI

44:44 Turing machines

49:06 How it feels to lead

Linkki: https://www.youtube.com/watch?v=PqVbypvxDto

- Liittynyt

- 18.02.2022

- Viestejä

- 3 129

Tätäkin viimeisintä sivua kun lukee (laskukone 3.0, työkalu jne) niin tuntuu, että tekoäly on käytännössä enimmäkseen hieno myyntisana jolla tykätään johtaa ihmisiä harhaan. Pitäisi enemmän vetää raja sille milloin puhutaan koneoppimisesta ja milloin tekoälystä. Mistään järjestelmästä ei tule vielä oikeasti millään mittarilla "älykästä" jos se suorittaa laskutehtäviä mitattavilla suureilla, tallentaa niitä muistiin ja ottaa ne huomioon laskiessaan uudelleen.

Silti markkinoilla on jos jonkinlaista järjestelmää "älykkääseen" lämmitykseen, valaistukseen, sähkönkulutuksen ohjaukseen jne jne. Pääasiassa ne noudattavat vanhaa opetettua kaavaa ja lisäävät siihen jonkinlaisella kertoimella sääennusteen, olosuhdemittauksen tai muun muuttuvan tekijän.

Sama sanoa älykkääksi järjestelmää joka seuraa vakioasetusta mutta kertoo sen satunnaiskertoimella joka ei ole oikeasti satunnainen vaan vaihtelee viikonpäivän järjestysnumeron mukaan välillä 1.0...1.7. Vaikuttaa siltä että se tekee jotain toisin kuin perinteinen vaikkei se ero perinteiseen ei olisi älykäs tai välttämättä edes hyödyllinen.

Silti markkinoilla on jos jonkinlaista järjestelmää "älykkääseen" lämmitykseen, valaistukseen, sähkönkulutuksen ohjaukseen jne jne. Pääasiassa ne noudattavat vanhaa opetettua kaavaa ja lisäävät siihen jonkinlaisella kertoimella sääennusteen, olosuhdemittauksen tai muun muuttuvan tekijän.

Sama sanoa älykkääksi järjestelmää joka seuraa vakioasetusta mutta kertoo sen satunnaiskertoimella joka ei ole oikeasti satunnainen vaan vaihtelee viikonpäivän järjestysnumeron mukaan välillä 1.0...1.7. Vaikuttaa siltä että se tekee jotain toisin kuin perinteinen vaikkei se ero perinteiseen ei olisi älykäs tai välttämättä edes hyödyllinen.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Juuri näin. Eihän meillä oikeasti ole mitään keinoälyä vielä, on vain koneoppimista&syväoppimista ja niiden päälle rakennettuja ratkaisuja kuten "reasoning" missä ajetaan samaa pyyntöä uudestaan ja uudestaan eri tavoilla niin että saadaan parempi vastaus,... Onko AI:na myyminen sitten lehtien vai markkinamiesten hommaa niin vaikea sanoa kuka AI:ksi brandaamisen aloitti. AGI myös huono termi kun yleensä se ymmärretään ihmisenkaltaisena älynä kaikkine hyvine ja huonoine puolineen. Tän takia nykyään puhutaan "super human intelligence" ja sen saavuttamisesta eri nicheissä kuten shakki, matematiikan laskeminen, auton ajaminen(waymo ajaa paremmin kun ihminen) jne. General pudotettu pois kun sellaisen saavuttamisen aikataulu ei ole tiedossa, on vain uskomuksia ja arvauksia.Tätäkin viimeisintä sivua kun lukee (laskukone 3.0, työkalu jne) niin tuntuu, että tekoäly on käytännössä enimmäkseen hieno myyntisana jolla tykätään johtaa ihmisiä harhaan. Pitäisi enemmän vetää raja sille milloin puhutaan koneoppimisesta ja milloin tekoälystä. Mistään järjestelmästä ei tule vielä oikeasti millään mittarilla "älykästä" jos se suorittaa laskutehtäviä mitattavilla suureilla, tallentaa niitä muistiin ja ottaa ne huomioon laskiessaan uudelleen.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Apple julkaisi supernopean koneoppimishärvelin millä voi tehdä 3d skenen(gaussian splat) mistä tahansa valokuvasta. Näitä on ollut ennenkin, mutta tämä open sourcea ja oikeasti nopea. Tuolla vois tehdä mielenkiintoisia asioita

Linkki: https://x.com/AIRevSpot/status/2001310621275705458

Linkki: https://x.com/AIRevSpot/status/2001310621275705458

Onko kenelläkään kokemuksia ChatPlayground.ai:sta? Näyttää olevan tarjolla elinikäisiä tilauksia StackSocialin kautta aika edullisesti. Ymmärsin, että yhdellä tilauksella pääsisi käyttämään yli 25 eri tekoälyä. Lisäksi jos ostaa Unlimited-paketin (79 $ + alv), luvataan “unlimited messages per month”.

Kuulostaa vähän liian hyvältä ollakseen totta, onko tämä oikeasti järkevä diili vai joku koijaus? Itse olen vasta harjoittelemassa näiden käyttöä, mutta äkkiseltään tuo vaikuttaa todella hyvältä verrattuna esimerkiksi ChatGPT:n 20 €/kk hintaan.

Kuulostaa vähän liian hyvältä ollakseen totta, onko tämä oikeasti järkevä diili vai joku koijaus? Itse olen vasta harjoittelemassa näiden käyttöä, mutta äkkiseltään tuo vaikuttaa todella hyvältä verrattuna esimerkiksi ChatGPT:n 20 €/kk hintaan.

- Liittynyt

- 17.10.2016

- Viestejä

- 5 019

Ei ole kokemusta tuosta mutta ihan näin mutu-perusteella mikä tahansa "unlimited" yhdisttetyynä elinikäiseen on aika epämääräistä ja varsinkin tekoälyn kohdalla herättää vielä enemmän epäilyjä. Esim Openrouterin kautta on saatavana DeepSeek käyttöön ilmaiseksi, mutta käytännössä tuo ilmainen pooli on täynnä kaikenmaailman kusettajia joiden DeepSeek instanssit spämmää joko "vaarallisia linkkejä" tai muuta epämääräistä sisältöä enimmäkseen (openrouter ei siis itse toimita AI palvelua vaan toimii eräänlaisena gatewayna eri AI laskentatehon tarjoajille)Onko kenelläkään kokemuksia ChatPlayground.ai:sta? Näyttää olevan tarjolla elinikäisiä tilauksia StackSocialin kautta aika edullisesti. Ymmärsin, että yhdellä tilauksella pääsisi käyttämään yli 25 eri tekoälyä. Lisäksi jos ostaa Unlimited-paketin (79 $ + alv), luvataan “unlimited messages per month”.

Kuulostaa vähän liian hyvältä ollakseen totta, onko tämä oikeasti järkevä diili vai joku koijaus? Itse olen vasta harjoittelemassa näiden käyttöä, mutta äkkiseltään tuo vaikuttaa todella hyvältä verrattuna esimerkiksi ChatGPT:n 20 €/kk hintaan.

Perplexity Pro:n antamat vastaukset kysymyksiin on jatkuvasti vakuuttavampia, ja samaan aikaan tuntuu että googlettamalla ei pääse mihinkään, lähinnä googlellakin se AI vastaus on kohtuullinen mutta itse hakutulokset ovat hämmentävän surkeita. Ja aiemmin olen mielestäni ollut ihan pätevä googlettaja, ja edelleen tietty tosi selkeät yksiselitteiset jutut löytyy. Mutta jos jotain monimutkaisempaa etsii niin ei vahingossakaan ole ekojen hakutulosten joukossa ne hyödylliset lähteet joita AI sen sijaan heti tarjoaa.

Mielenkiintoista mutta vähän huolestuttavaa kehitystä kaikkiaan.

Mielenkiintoista mutta vähän huolestuttavaa kehitystä kaikkiaan.

- Liittynyt

- 07.02.2017

- Viestejä

- 3 149

Sama havainto goglettamisen nykytilanteesta. Lisäksi tekoälykin pettää vähän turhan usein, eli harmillinen tilanne ainakin toistaiseksi. Kohta tulee varmasti muutama nimimerkki toteamaan että olet vaan paska googlettamaan ja tekoälyltäkin kysyt ihan vääria asioita.Perplexity Pro:n antamat vastaukset kysymyksiin on jatkuvasti vakuuttavampia, ja samaan aikaan tuntuu että googlettamalla ei pääse mihinkään, lähinnä googlellakin se AI vastaus on kohtuullinen mutta itse hakutulokset ovat hämmentävän surkeita. Ja aiemmin olen mielestäni ollut ihan pätevä googlettaja, ja edelleen tietty tosi selkeät yksiselitteiset jutut löytyy. Mutta jos jotain monimutkaisempaa etsii niin ei vahingossakaan ole ekojen hakutulosten joukossa ne hyödylliset lähteet joita AI sen sijaan heti tarjoaa.

Mielenkiintoista mutta vähän huolestuttavaa kehitystä kaikkiaan.

Tekoälyltä saa hieman yllättäen fiksumpia ja perusteluiltaan parempia vastauksia ja näkökulmia tämän ketjun aiheisiin, verrattuna siihen mitä tänne kirjoittaminen tuottaa. Kirjoitin "yllättäen" siksi, että tekoälyltä sitä enemmän odottaisi sellaista oman erinomaisuuden korostamista.

Viimeksi muokattu:

- Liittynyt

- 10.07.2017

- Viestejä

- 2 605

No minä olen huomannut, että tekoälyä joutuu nykyään yhä useammin "houkuttelemaan" yrittämään enemmän. Ilmeisesti suurin osa ihmisistä käyttää tekoälyä googlena ja kyselee triviaaleja kysymyksiä. Voisiko olla, että resurssien säästämiseksi vastataan helpoimman kautta aluksi, joka ei syö paljon tokeneita ja sitten kun alkaa prässäämään, niin käytetään vähän enemmän.

Tähän jotenkin kävisi järkeen se kun OpenAI piilotti kielimallit jossain välissä, ettei valittaisi "parasta mallia" siihen millon on Minna Canthin päivä? kysymykseen, vaan kielimalli arvotaan kysymyksen mukaan.

Tähän jotenkin kävisi järkeen se kun OpenAI piilotti kielimallit jossain välissä, ettei valittaisi "parasta mallia" siihen millon on Minna Canthin päivä? kysymykseen, vaan kielimalli arvotaan kysymyksen mukaan.

- Liittynyt

- 17.10.2016

- Viestejä

- 5 019

Googlelta on tainnut tulla tuo Gemini 3 nyt persaukisten (eli minun) käytettäväksi. Onko muilla kokemusta onko tuo kuinka kova satuilemaan kun aikaisempaan versioon verrattuna tuo tuntuu höpöttävän välillä täyttä paskaa sinisilmäisesti. Pyysin sitä kokeeksi analysoimaan joidenkin kappaleiden sanoja ja se höpötti tuntevansa kappaleet mutta kertoi monesti täysin väärän artistin kappaleelle. Samoin kun kyselin ohjeita Nokian vanhojen matkapuhelinten tehdas resettiin niin se kyllä vakuuttavasti satuili sitä ja tätä mutta ei juuri siihen malliin toimivaa ohjetta.

Tuo kyllä osaa kirjoittamisen ulkoasun osalta tehdä paljon sujuvampaa tekstiä kuin aikaisempi mutta tuntuu että sekoittaa asioita keskenään todella paljon enemmän.

Tuo kyllä osaa kirjoittamisen ulkoasun osalta tehdä paljon sujuvampaa tekstiä kuin aikaisempi mutta tuntuu että sekoittaa asioita keskenään todella paljon enemmän.

Omat kokemukset ovat että jos kyselee suoraan Geminiltä tai Copilotilta niin vastaukset ovat yleensä ihan ok, mutta esimerkiksi google-haussa se AI-vastaus tuntuu olevan aika usein ihan puutaheinää. Toki tuo saattaa johtua ihan siitäkin että en mihinkään google-hakuun kirjoittele mitään pitkiä lauseita vaan muutamia oleellisia avainsanoja joten AI ei ehkä niistä oikein niin hyvin keksi mitä olen hakemassa.

Google-haku itsessään on tuntunut menevän huonompaan suuntaan jo pidemmän aikaa, varmaankin aika pitkälti sen takia että kaikenlaisen AI-höpöhöpön määrä netissä on kasvanut koko ajan kiihtyvällä tahdilla. Tuo tietty on jonkun verran ainakin omaa hakukäyttäytymistä muuttanut siihen että aika herkästi nykyään menen kysymään suoraan tekoälyltä enkä edes yritä googlella löytää vastausta kaiken ryönän joukosta.

Google-haku itsessään on tuntunut menevän huonompaan suuntaan jo pidemmän aikaa, varmaankin aika pitkälti sen takia että kaikenlaisen AI-höpöhöpön määrä netissä on kasvanut koko ajan kiihtyvällä tahdilla. Tuo tietty on jonkun verran ainakin omaa hakukäyttäytymistä muuttanut siihen että aika herkästi nykyään menen kysymään suoraan tekoälyltä enkä edes yritä googlella löytää vastausta kaiken ryönän joukosta.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

AI:n ajaminen maksaa, google hakuja valtava määrä. Google ajanee jollain pienellä ja erittäin halvalla mallilla hakuihin AI-vastaukset. Gemini/chatgpt/perplexity pro/muut maksulliset niin voi ajaa kysymyksen isomman ja kalliimman mallin läpi. Sama juttu kuin superkalliit pro mallit antavat vieläkin paremman vastauksen kuin halvimman tilauksen tarjoamat mallit. AI puolella saa just sitä mistä maksaa, erot ilmaisen, halvan ja kalleimman välillä valtavia.Omat kokemukset ovat että jos kyselee suoraan Geminiltä tai Copilotilta niin vastaukset ovat yleensä ihan ok, mutta esimerkiksi google-haussa se AI-vastaus tuntuu olevan aika usein ihan puutaheinää. Toki tuo saattaa johtua ihan siitäkin että en mihinkään google-hakuun kirjoittele mitään pitkiä lauseita vaan muutamia oleellisia avainsanoja joten AI ei ehkä niistä oikein niin hyvin keksi mitä olen hakemassa.

---

Nvidia julkaisi uuden mallin open sourceen. Mielenkiintoista nemotron3:ssa että avoimien painojen lisäksi nvidia julkaisi reseptit ja isoilta osin datat millä malli opetettu. Mallin voisi siis kotona opettaa itse alusta lähtien uusiksi vaikka oman yrityksen datalla. Moni open source malli ei ole julkaissut mallin opettamiseen tarvittavaa dataa+reseptejä. Mallin pienin versio ulkona. Tuosta tulee vielä kaksi isompaa versiota kevään aikana.

NVIDIA Nemotron 3 Family of Models

Models Nemotron 3 White Paper Nano Tech Report Super Tech Report Try It!

- Liittynyt

- 07.02.2017

- Viestejä

- 3 149

Ihan yhtä rempseasti lähtee tällä uudellakin "game changerilla" lapasesta mitä aiemmalla.Googlelta on tainnut tulla tuo Gemini 3 nyt persaukisten (eli minun) käytettäväksi. Onko muilla kokemusta onko tuo kuinka kova satuilemaan kun aikaisempaan versioon verrattuna tuo tuntuu höpöttävän välillä täyttä paskaa sinisilmäisesti.

Pyysin laiskuuttani tätä laskemaan valokuvasta (poikkileikattu puunrunko) vuosirenkaat ja sen perusteella kertomaan kuinka vanha puu tuli äsken kaadettua. Kertoi että ei voi laskea, koska moottorisahan jäljet sotkevat tekstuurin. Antoi sitten nipun yksityiskohtaisia käytännön ehdotuksia kuinka hioa tai höylätä pintaa, jotta laskeminen onnistuu (tämä kieltämättä noudatti hyvin antamaani yleisohjetta antaa käytännön ratkaisu- tai toimintaehdotuksia mikäli mahdollista). Mutta että ihan hiomapaperin karkeutta myöten jne... Laskin itse lopulta ja 75-80 vuotta puulla ikää.

Jostain syystä tämä ei riittänyt, vaan gemini alkoi satuilemaan puulajista siihen päälle. Pyytämättä ja kysymättä. Kertoi että kyseesä on tammi (oli koivu) ja että tummempi väri puun ytimessä on tyypillistä tälle puulajille (koivulle hyvin tyypillinen tyvilaho oikeasti kyseessä).

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Riippuu tehtävästä ja miten hyvin sen tehtävän osaa prompata. Voi olla että ilmainen osaa, voi olla ettei osaa. Sun tarvisi kertoa tarkemmin mistä on kysymys. Jos heittää vain "tee X" niin todennäköisesti ei toimi edes maksullisessa. Tän hetken parastakin AI:ta kannattaa ajatella tietoviisaana kesähessuna jolta puuttuu normijärki ja kokemus. Tethtävä pitää selittää kuten kesähessulle joka tuli yliopistolta ensimmäiseen työpaikkaan.Mitkä tekoälyt osaa myös tehdä heti suoraan tehtäviä mitä antaa?

Tai vaatiiko missä kaikissa maksullisuutta?

- Liittynyt

- 23.07.2023

- Viestejä

- 3 187

Ihan mielenkiintoinen keskustelu kulttuuriykkösessä tekoälystä. Mitä tulee yleisemminkin sitten niihin pohdintoihin tekoälyn tietoisuudesta, se on Tiede- lehden mukaan siksi pirullinen aihe että kukaan muu ei voi käytännössä päättää onko joku taho tietoinen vai ei, kuin se itse. Eli tietoisuuden määrittely on sivullisilta erittäin vaikea tehtävä, ellei jopa mahdoton.

Nythän viikolla uutisoitiin jo jostain japanilaisesta ( vai oliko e-korealainen??) nainen joka meni naimisiin tekoälyn kanssa. Tämä ihan vain sivu-uutisena.

Mutta itse tästä aiheesta. Ensiksi ajateltiin että mikäli koneäly kykenee samanlaiseen matemaattiseen päättelyyn ja lahjakkuuteen kuin ihminen, sitten se on jo ihmisen veroinen. Ja tekoäly pystyi. Sitten ajateltiin äkkiä ettei tuo olekaan se ihmisyyden ydin, vaan kielellinen osaaminen ja ymmärrys. No kuinkas sitten kävikään, tekoäly tuossakin voittaa ihmisen käytännössä ihan jokaisella osa-alueella. Tämän jälkeen ajateltiin että luovuushan se on ihan sitä ihmisen toiminnan keskeisiä periaatteita, sitä ei ainakaan tekoäly voita. Mutta kuinkas sitten kävikään? Niin, tekoäly jo nyt tuntuu voittavan ihmisen käytännössä oikeastaan ihan millä mittarilla tahansa. Tästäkin käydään podcastissa keskustelua.

Nythän viikolla uutisoitiin jo jostain japanilaisesta ( vai oliko e-korealainen??) nainen joka meni naimisiin tekoälyn kanssa. Tämä ihan vain sivu-uutisena.

Mutta itse tästä aiheesta. Ensiksi ajateltiin että mikäli koneäly kykenee samanlaiseen matemaattiseen päättelyyn ja lahjakkuuteen kuin ihminen, sitten se on jo ihmisen veroinen. Ja tekoäly pystyi. Sitten ajateltiin äkkiä ettei tuo olekaan se ihmisyyden ydin, vaan kielellinen osaaminen ja ymmärrys. No kuinkas sitten kävikään, tekoäly tuossakin voittaa ihmisen käytännössä ihan jokaisella osa-alueella. Tämän jälkeen ajateltiin että luovuushan se on ihan sitä ihmisen toiminnan keskeisiä periaatteita, sitä ei ainakaan tekoäly voita. Mutta kuinkas sitten kävikään? Niin, tekoäly jo nyt tuntuu voittavan ihmisen käytännössä oikeastaan ihan millä mittarilla tahansa. Tästäkin käydään podcastissa keskustelua.

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Teknologiamielessä on vaikea nähdä miten LLM voisi saavuttaa tietoisuuden. Se on vain algoritmi mihin syötetään tokenia sisään ja tulee tokenia ulos. Kaikenlainen päättely, agentit yms. mitä lisätty ovat vain yhdenlainen silmukka minkä sisällä kutsutaan llm:aa eikä jonkinlainen älykäs mekanismi minkä LLM on kehittänyt sisällensä.Ihan mielenkiintoinen keskustelu kulttuuriykkösessä tekoälystä. Mitä tulee yleisemminkin sitten niihin pohdintoihin tekoälyn tietoisuudesta, se on Tiede- lehden mukaan siksi pirullinen aihe että kukaan muu ei voi käytännössä päättää onko joku taho tietoinen vai ei, kuin se itse. Eli tietoisuuden määrittely on sivullisilta erittäin vaikea tehtävä, ellei jopa mahdoton.

Toki kun LLM ennustaa tokeneita niin sopivalla promptilla LLM:n saa vaikuttamaan siltä, että se olisi tietoinen itsestänsä tai esittää olevansa henkilö X, mutta edelleen LLM oikeasti vain ennustaa seuraavia tokeneita.

Toki jos menee tarpeeksi syvälle voi kyseenaalaistaa onko ihminenkin vain biologinen kone, vapaa tahto vai biologia määrää vai jopa deterministinen universumi joka toimii omien lakiensa pohjalta ilman että mitään voi muuttaa, kaikki tapahtuu sääntöjen mukaan. Yksi suunta mitä osa tutkijoista tutkii ja uskoo todeksi "deterministic quantum technology" sen sijaan että kvanttilaskenta olisi todennäköisyyksiin perustuva.

Anthropic:lla on imho. hyviä mekanismeja mitä vastaan testaavat malleja. Nyt testaavat malleja määrittelemänsä safety level 3:en mukaan

- ASL-3 refers to systems that substantially increase the risk of catastrophic misuse compared to non-AI baselines (e.g. search engines or textbooks) OR that show low-level autonomous capabilities.

Activating AI Safety Level 3 protections

We have activated the AI Safety Level 3 (ASL-3) Deployment and Security Standards described in Anthropic’s Responsible Scaling Policy (RSP) in conjunction with launching Claude Opus 4. The ASL-3 Security Standard involves increased internal security measures that make it harder to steal model...

asl-4 tasoa ei taida olla vielä määritelty kunnolla, mutta tästä voi katsoa mitä anthropic arvelee seuraavaksi tarvittavan: Three Sketches of ASL-4 Safety Case Components

Viimeksi muokattu:

- Liittynyt

- 23.07.2023

- Viestejä

- 3 187

Siis on täysin selvää että tuo "tekoälyn tietoisuus" on puhdasta sci-fiä.Teknologiamielessä on vaikea nähdä miten LLM voisi saavuttaa tietoisuuden. Se on vain algoritmi mihin syötetään tokenia sisään ja tulee tokenia ulos. Kaikenlainen päättely, agentit yms. mitä lisätty ovat vain yhdenlainen silmukka minkä sisällä kutsutaan llm:aa eikä jonkinlainen älykäs mekanismi minkä LLM on kehittänyt sisällensä.

Toki kun LLM ennustaa tokeneita niin sopivalla promptilla LLM:n saa vaikuttamaan siltä, että se olisi tietoinen itsestänsä tai esittää olevansa henkilö X, mutta edelleen LLM oikeasti vain ennustaa seuraavia tokeneita.

Toki jos menee tarpeeksi syvälle voi kyseenaalaistaa onko ihminenkin vain biologinen kone, vapaa tahto vai biologia määrää vai jopa deterministinen universumi joka toimii omien lakiensa pohjalta ilman että mitään voi muuttaa, kaikki tapahtuu sääntöjen mukaan. Yksi suunta mitä osa tutkijoista tutkii ja uskoo todeksi "deterministic quantum technology" sen sijaan että kvanttilaskenta olisi todennäköisyyksiin perustuva.

Anthropic:lla on imho. hyviä mekanismeja mitä vastaan testaavat malleja. Nyt testaavat malleja määrittelemänsä safety level 3:en mukaan

Activating AI Safety Level 3 protections

We have activated the AI Safety Level 3 (ASL-3) Deployment and Security Standards described in Anthropic’s Responsible Scaling Policy (RSP) in conjunction with launching Claude Opus 4. The ASL-3 Security Standard involves increased internal security measures that make it harder to steal model...www.anthropic.com

asl-4 tasoa ei taida olla vielä määritelty kunnolla, mutta tästä voi katsoa mitä anthropic arvelee seuraavaksi tarvittavan: Three Sketches of ASL-4 Safety Case Components

Tekoäly juuri kertoili että etteivät ne pysty kokemaan maailmaa, tuntemaan tunteita ja tiedostamaan omaa olemassaoloaan. Mutta sanoi myös että tietoisuuden kehittyminen ei sinänsä vaatisi "enemmän vapauksia" tekoälylle kuten kysymyksessäni sen muotoilin, vaan ennemminkin tutkimaan sitä mitä tietoisuus ylipäätään on. Vastaus tuohon kysymykseen on todellisuudessa erittäin vaikea, jaon myöskin pohdituttanut huippuajattelijoita jo vuosituhansia, noin muutenkin.

Lisäksi tekoälyn mukaan pitäisi rakentaa järjestelmiä, joiden avulla tekoälyt pystyisivät ymmärtämään ja mallintamaan omaa toimintaansa, toisaalta muistuttaen tai oikeammin kysyen siitä että olisiko tietoinen tekoäly edes tavoiteltava asia? Hmm. Missä me todellakin edes tarvittaisiin tuollaista? Jo tälläisenaankin tekoäly tulee muuttamaan ihmisen maailmaa ( toivottavasti parempaan ).

Vielä tuosta kulttuuriykkösen linkatusta keskustelusta, siellä puhutaan lisäksi mm.

- voiko tekoälyn kanssa aidosti ystävystyä ( ns. parasosiaalinen suhde tai muunnelma siitä )

- tekoälyllä ei ole tunteita, mutta se on älyttömän hyvä käsittelemään niitä

- tunnetriggeröinnin kautta toimiva maailma on jo todellisuutta, eli algoritmit on suunniteltu tuomaan ihmisille sisältöä jotka "herättävät tunteita" ja tekoälyt toimii taustalla

- tästä syystä meillä esim. Donald Trump nyt USA:n pressana, ei mitään väliä mitä hän sanoo, kunhan tunteet newsfeedissä triggeröityy yms

- tekoäly on huipputunnistaja sen suhteen että mistä jokainen erillinen yksilö triggeröityy

Tuohon vastaus nähtävästi vaihtelee rankasti sen mukaan kuinka kehittynyttä ja paljon/vähän vapauksia omaavalta tekoälyltä asiaa kysyy.

Jos tietoisuutta miettii niin aika hyvä kysymys on on se, milloin munasolun hedelmöittymisen jälkeen ollaan siinä tilanteessa että meillä on tietoisuus joka jollain selkeällä objektiivisella tasolla on tietoisempi kuin mikään tähän mennessä tehty keinotekoinen kokonaisuus?

Toisaalta sikäli mikäli AIsta tulisi niin älykäs ja itseään parenteleva jne. että se kykenisi annetun ohjeen perusteella kehittämään itsensä tasolle jolla voi esim. "tuhota kaikki ihmiset" niin miten relevantti on kysymys tietoisuudesta? Ja tietty tämä on tosi kaukana.

Toisaalta sikäli mikäli AIsta tulisi niin älykäs ja itseään parenteleva jne. että se kykenisi annetun ohjeen perusteella kehittämään itsensä tasolle jolla voi esim. "tuhota kaikki ihmiset" niin miten relevantti on kysymys tietoisuudesta? Ja tietty tämä on tosi kaukana.

Viimeksi muokattu:

finWeazel

Tukijäsen

- Liittynyt

- 15.12.2019

- Viestejä

- 14 143

Onhan noita putiikkeja jotka yrittävät tehdä AGI:ta. Moni uskoo, että AGI on loppujen lopuksi hyvin yksinkertainen toteuttaa, mutta ei tiedetä miten. Esim. john carmack pyörittää pientä puljua missä kovia tyyppejä ja yrittävät vain AGI:ta

dallasinnovates.com

dallasinnovates.com

Se mitä lyhyellä aikavälillä haetaan on Super Human Intelligence ja tämä kohdistettuna erilaisiin niche sovelluksiin missä AI toimii ihmisen apurina. Koodiavustin, tekstin summarointi, kuvanluonti, lakiavustin, ai-tukibotti, matematiikan laskeminen, kielestä toiseen kääntäminen jne. Osassa näistä voisi väittää että SHI toteutui jo 2025 aikana jos mittarina käytetään 99.9% ihmisistä eikä sitä kourallista jotka ovat miljardeista ihmisistä parhaat. AI:lle triviaalia laskea laajan matematiikan yo-kokeen tehtävät, suurin osa ihmisistä no can do jos aikaa päivä työkaluina maol, kynä, paperi, peruslaskukone. Otetaan random 100 ihmistä kun kävelee citymarkettiin ekana aamusta sisään ja koepaperit nenäneteen.

AGI ei ole millään tavalla relevantti lyhyellä tähtäimellä kun SHI tyyliset järjestelmät on se mistä saadaan käytännön hyödyt.

One of the things I say—and some people don’t like it—is that the source code, the computer programming necessary for artificial general intelligence, is going to be a few tens of thousands of lines of code. Now, a big program is millions of lines of code—the Chrome browser is like 20 to 30 million lines of code.

Exclusive Q&A: John Carmack's 'Different Path' to Artificial General Intelligence

John Carmack, the iconic Dallas game developer, rocket engineer, and VR pioneer, is taking aim now at solving AGI. If successful, his moonshot effort would be a ‘change-the-world-level’ event.

Se mitä lyhyellä aikavälillä haetaan on Super Human Intelligence ja tämä kohdistettuna erilaisiin niche sovelluksiin missä AI toimii ihmisen apurina. Koodiavustin, tekstin summarointi, kuvanluonti, lakiavustin, ai-tukibotti, matematiikan laskeminen, kielestä toiseen kääntäminen jne. Osassa näistä voisi väittää että SHI toteutui jo 2025 aikana jos mittarina käytetään 99.9% ihmisistä eikä sitä kourallista jotka ovat miljardeista ihmisistä parhaat. AI:lle triviaalia laskea laajan matematiikan yo-kokeen tehtävät, suurin osa ihmisistä no can do jos aikaa päivä työkaluina maol, kynä, paperi, peruslaskukone. Otetaan random 100 ihmistä kun kävelee citymarkettiin ekana aamusta sisään ja koepaperit nenäneteen.

AGI ei ole millään tavalla relevantti lyhyellä tähtäimellä kun SHI tyyliset järjestelmät on se mistä saadaan käytännön hyödyt.

Uutiset

-

Uusi artikkeli: Testissä Honor 600

7.5.2026 13:02

-

Huawei lanseerasi uudet Watch Fit 5 -älykellot aktiiviseen elämäntapaan

7.5.2026 12:30

-

be quiet! julkaisi uudet Dark Rock 6 -sarjan tornicoolerit prosessoreille

7.5.2026 08:24

-

AMD julkaisi uudet AMD Software 26.5.1 -ajurit näytönohjaimilleen ja grafiikkaohjaimilleen

7.5.2026 02:00

-

Lian Li julkaisi mATX-kokoluokkaan uuden Vector V150 INF -kotelon

6.5.2026 16:00