- Liittynyt

- 14.10.2016

- Viestejä

- 25 006

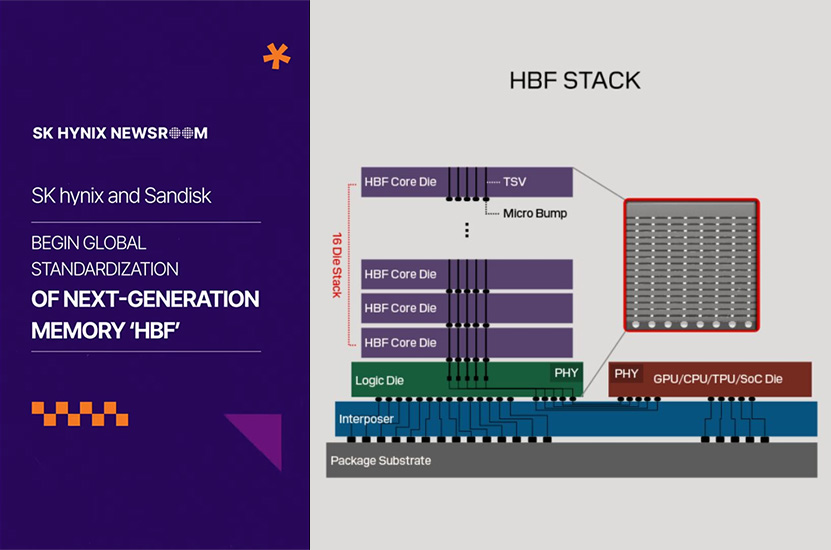

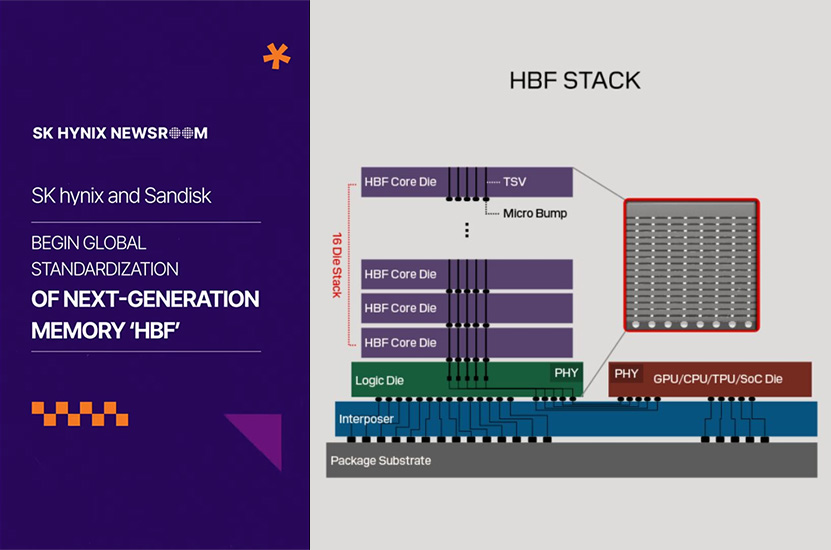

Open Compute Platformin alaisuudessa tehtävä standardointi tuo High Bandwidth Flash -muistit täyttämään aukkoa nopeiden HBM-muistien ja suurikapasiteettisten tallennusmedioiden välillä.

Uutisoimme reilu vuosi sitten SanDiskin esitelleen uuden High Bandwidth Flash -teknologian kilpailemaan tekoälymarkkinoilla HBM-muistien kanssa. Nyt SK Hynix ja Sandisk ovat alkaneet HBF:n standardointiprosessin Open Compute Projectin alaisuudessa.

SanDiskin alun perin kehittelemä HBF-teknologia muistuttaa hyvin läheisesti HBM-muisteja, mutta DRAM-sirujen sijasta niissä on pinottu päällekkäin enintään 16 NAND Flash -sirua. Flash-muistit on perinteisesti suunniteltu kustannustehokkuus edellä käyttämällä yhtä I/O-porttia massiivisen soluverkoston kaverina, mutta HBF:ssä käytetään sen sijasta useita soluverkostoja ja useita I/O-portteja kaistan maksimoimiseksi.

HBF-muistin piti alkuperäisen esittelyn mukaan tarjota HBM-muistia vastaavaa kaistaa, mutta SK Hynixin tiedotteessa annetaan tilanteesta hieman erilainen kuva. Tiedotteen mukaan HBF täyttää aukon erittäin nopeiden HBM-muistien ja korkean kapasiteetin tallennusmedioiden välillä. Ne on suunniteltu erityisesti päättelytehtäviin, joissa muistin kapasiteetilla on suuri merkitys. SanDiskin aiemmassa esittelyssä kahdeksalla HBM-pinolla varustetulla piirillä oli käytössään 192 Gt muistia, kun kahdeksalla HBF-sirulla päästään jopa 4 teratavuun. Lisäksi HBF-muisteja voidaan käyttää HBM-muistien rinnalla, jolloin piirille voidaan tarjota pienempi määrä erittäin korkean kaistan HBM-muistia ja suuri määrä HBF-muistia sen rinnalla.

Lähde: SK Hynix

Uutisoimme reilu vuosi sitten SanDiskin esitelleen uuden High Bandwidth Flash -teknologian kilpailemaan tekoälymarkkinoilla HBM-muistien kanssa. Nyt SK Hynix ja Sandisk ovat alkaneet HBF:n standardointiprosessin Open Compute Projectin alaisuudessa.

SanDiskin alun perin kehittelemä HBF-teknologia muistuttaa hyvin läheisesti HBM-muisteja, mutta DRAM-sirujen sijasta niissä on pinottu päällekkäin enintään 16 NAND Flash -sirua. Flash-muistit on perinteisesti suunniteltu kustannustehokkuus edellä käyttämällä yhtä I/O-porttia massiivisen soluverkoston kaverina, mutta HBF:ssä käytetään sen sijasta useita soluverkostoja ja useita I/O-portteja kaistan maksimoimiseksi.

HBF-muistin piti alkuperäisen esittelyn mukaan tarjota HBM-muistia vastaavaa kaistaa, mutta SK Hynixin tiedotteessa annetaan tilanteesta hieman erilainen kuva. Tiedotteen mukaan HBF täyttää aukon erittäin nopeiden HBM-muistien ja korkean kapasiteetin tallennusmedioiden välillä. Ne on suunniteltu erityisesti päättelytehtäviin, joissa muistin kapasiteetilla on suuri merkitys. SanDiskin aiemmassa esittelyssä kahdeksalla HBM-pinolla varustetulla piirillä oli käytössään 192 Gt muistia, kun kahdeksalla HBF-sirulla päästään jopa 4 teratavuun. Lisäksi HBF-muisteja voidaan käyttää HBM-muistien rinnalla, jolloin piirille voidaan tarjota pienempi määrä erittäin korkean kaistan HBM-muistia ja suuri määrä HBF-muistia sen rinnalla.

Lähde: SK Hynix